張田勘

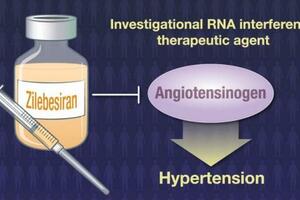

北京市衛健委日前牽頭組織制定了《北京市網際網路診療監管實施辦法(試行)》,並向社會公開徵求意見,公眾可於 9 月 16 日前向市衛健委反饋意見。根據辦法:醫療機構開展網際網路診療活動要加強藥品管理,嚴禁使用人工智慧等自動生成處方,嚴禁在處方開具前向患者提供藥品。

雖然「嚴禁使用人工智慧等自動生成處方」只是徵求意見中的一種,而且可能會引發爭議,但是從目前AI的發展來看,禁用AI自動生成處方利大於弊。AI現在還不成熟,還處在發展階段,在涉及健康和生命這樣生死攸關的問題上,需要暫時的禁止或更長時間的禁止。

現階段AI介入醫療領域涉及兩個根本問題,一是AI診治疾病,包括自動生成處方是否靠譜;二是如果AI自動生成處方並讓病人獲得治療,包括服藥、手術和使用器械等,一旦產生意外,誰來負責。

AI早就在介入醫療領域了,較早、也是全球聞名的是2011年國際商用機器公司(IBM)創造的沃森醫生(Watson Health),儘管當時對一些疾病的正確診斷率達到73%,但直至今天,沃森醫生也不能單獨上崗,因為這個正確診斷率還是太低。

另一方面,即便是通過深度學習,AI的決策與人工醫生也存在差異,尤其是原則差異。例如,在診治疾病時,是以患者生命長度為第一要素,還是把生命質量放在首位,或者說兼顧這二者。人工醫生首先是會兼顧這二者,而且要考慮患者的經濟、家庭情況,以及患者康復後是否還有工作能力。從這些方面平衡,人工醫生的優勢是顯而易見的。

此外,讓AI醫生單獨或自動開處方,如果出現醫療事故,如造成患者更大的傷害,甚至讓患者喪失生命時,負責和索賠的主體是AI醫生,還是研發AI醫生的公司,抑或是購入和使用AI醫生的醫療機構和醫生。在法律主體不能確認時,AI醫生是不可能單獨診治疾病的。

正因這些原因,現在無論中國還是國外的醫療機構都只是引進了臨床決策支持系統(CDSS),也即廣義上的AI醫生,這是一種為醫護人員臨床診療提供多種幫助的計算機輔助信息系統。截至2020年5月,全國31個省份的1013所醫療機構中有19.6%的醫院有CDSS。至於其他各個學科各種疾病的AI醫生,也都是助手,AI不可以、也不可能取代醫生,不應有處方權。

禁止AI醫生自動生成處方還有一種人機衝突因素,即真人醫生發現AI醫生錯了時,是按真人醫生的意見辦還是按AI醫生的意見辦。這個困境的背後也是誰負責的問題。如果是人工醫生錯了,當然是醫生負責,但如果是AI醫生錯了,它能負責嗎?更進一步的困境是,人工醫生面對AI醫生,也許會為了避免承擔責任,不會主動糾正AI醫生的錯誤,而這很可能會導致醫療事故。

哪怕是AI醫生有99%的正確率,恐怕也無法獲得單獨的處方權和治療權,而是必須只為真人醫生和護士當助手。當然,醫生有會診的傳統,這是共同討論病例,各抒己見並取得對疾病,尤其是對疑難疾病共識的好方式。在未來,AI醫生或許可以加入到會診中,這也是AI醫生的一個重要角色。

漫畫/陳彬

來源:北京青年報